Эволюция серверов: от громоздких ЭВМ до ЦОДов в океане

с помощью нейросети

За последние полвека серверная архитектура прошла путь от массивных вычислительных машин до распределенных облачных платформ. Но сегодня индустрия сталкивается с фундаментальными вызовами: частоту процессоров сдерживают тепловыделение, литография приближается к физическим пределам, а системы охлаждения потребляют всё больше энергии. При этом спрос на вычислительные мощности продолжает расти. Разбираем, как отрасль оказалась в этой точке и что ее ждет дальше.

- как выглядели предшественники современных серверов

- зачем нужны подводные дата-центры

- что представляют собой коммутационные фабрик

- как работает дезагрегация

Формирование серверной архитектуры: ключевые этапы

Историю серверов можно разделить на три основных этапа: зарождение их как класса, оформление как типа оборудования и интенсивное масштабирование.

Становление 1950−1980-х. От локальных сетей до «службы» интернету

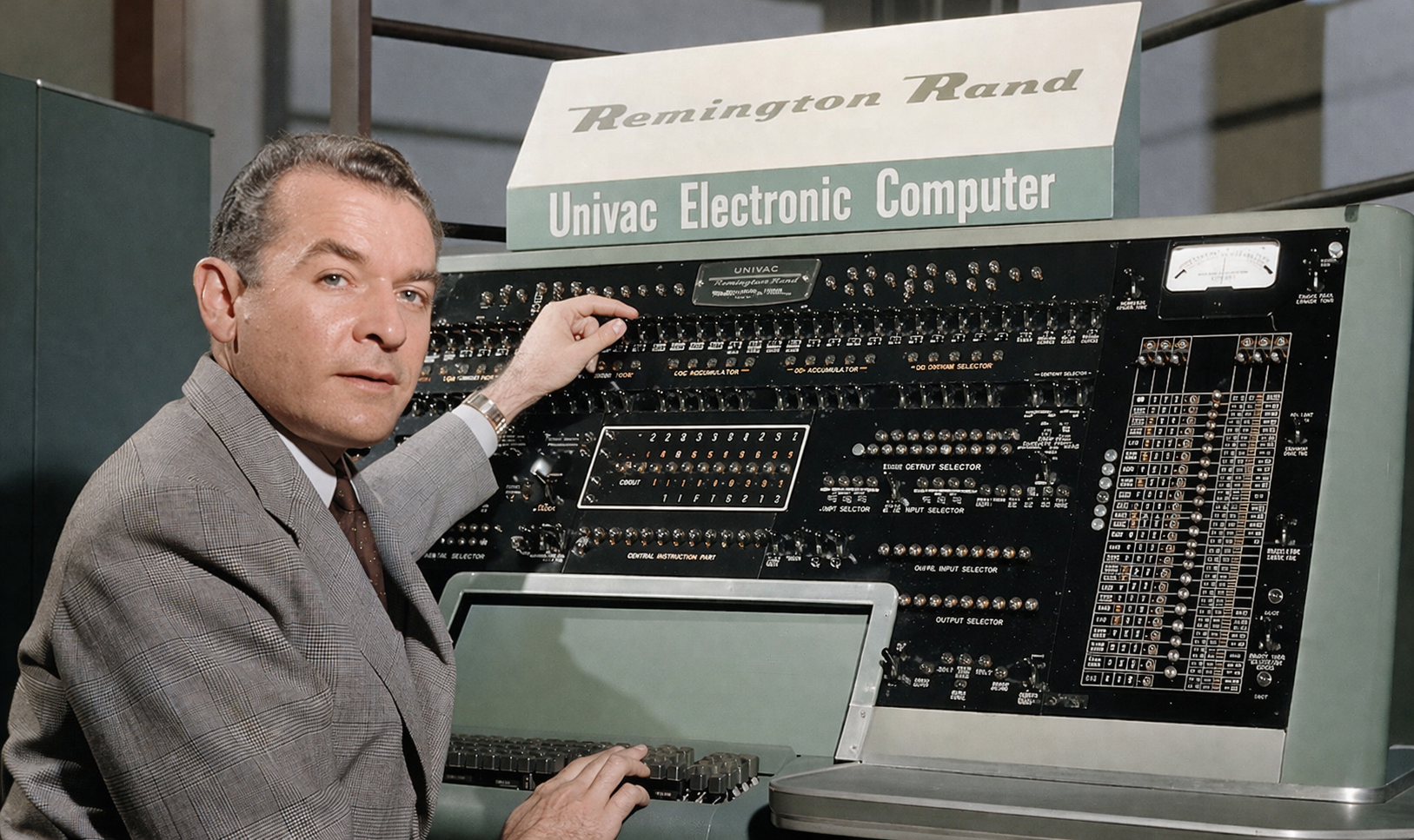

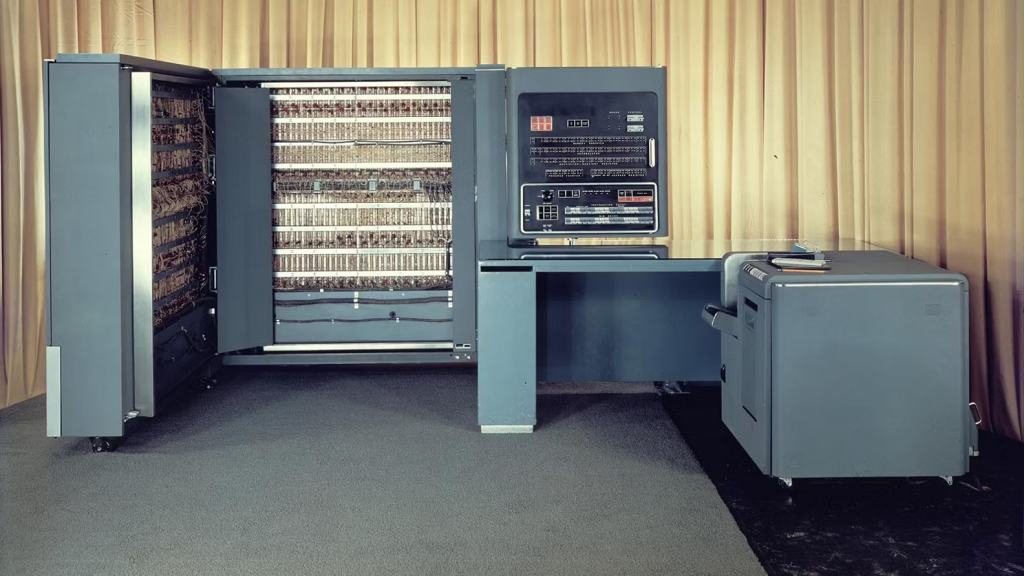

Прообразы серверов появились еще в 1950-х в эпоху мейнфреймов — централизованных вычислительных систем, к которым пользователи подключались через терминалы. Однако эти габаритные ЭВМ, такие как IBM 701 или UNIVAC I, мало напоминали современные серверы: они не распределяли нагрузку, а наоборот — концентрировали все вычисления в одном узле.

Импульсом для становления серверов в их современном понимании послужило активное развитие локальных вычислительных сетей в конце 1980-х.

Если до этого сервер был просто большим компьютером, то сети определили саму его суть, выраженную английским глаголом to serve — «служить». В те годы вычислительные машины впервые начали выполнять новую задачу — отдавать данные пользователям.

Распространение интернета привело к следующему технологическому скачку: появилась задача обслуживать всё, что связано со Всемирной паутиной. Серверов становилось всё больше, и индустрия постепенно пришла к мысли об их унификации.

Взросление 1990−2000-х. Архитектура х86 и бум ЦОДов

Следующий значимый этап в развитии серверов — доминирование архитектуры x86, которая пришла на смену популярных решений начала 90-х: SPARC от Sun Microsystems, Alpha от Digital Equipment Corporation, POWER от IBM. Они различались подходом к вычислениям и масштабированию: SPARC и POWER делали ставку на надежность и работу в крупных корпоративных системах, а Alpha — на максимальную производительность и скорость. Но все эти решения были дорогими и закрытыми.

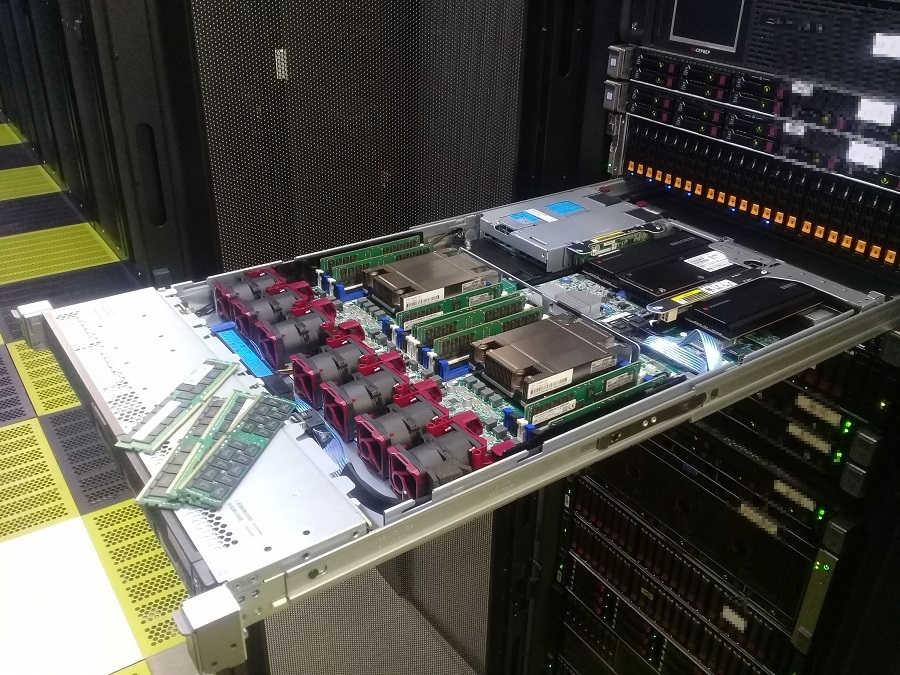

Постепенно х86 вытеснила специализированные архитектуры за счет массовости, стандартизации и более низкой стоимости. Из упомянутых выше до сих пор на рынке осталась только одна — IBM POWER. А рост потребностей в серверах в конечном счете привел к строительству множества центров обработки данных (ЦОД).

Один физический сервер теперь мог работать как десятки независимых машин, что повысило загрузку оборудования и при этом снизило стоимость вычислений. Запуск Amazon Web Services в 2006 году продемонстрировал возможности облачной модели пользования широкому кругу пользователей.

Масштабирование 2010−2020-х. Гиперскейлеры и гиперконвергенция

Виртуализация привела к появлению нового класса компаний — гиперскейлеров: крупнейшие облачные провайдеры, такие как Amazon, Google и Microsoft, нарастили огромные парки серверного оборудования и стали сдавать эти гигантские вычислительные мощности в аренду. А чтобы снизить издержки и повысить эффективность, гиперскейлеры взялись за пересборку инфраструктуры — пересмотрели ее архитектуру.

Так появилась гиперконвергенция — подход, при котором вычисления, хранение данных и сеть объединяются в единый программно управляемый комплекс. Проще говоря, вместо разрозненных устройств — один универсальный «конструктор», который можно гибко настраивать под задачу.

Современные вызовы. Технологии vs физика

Сегодня потребность в вычислительных мощностях продолжает расти, и главный драйвер здесь — данные. Причем значительная их часть — это повседневный цифровой поток, такой как обмен информацией в соцсетях, стриминговые видео, рутинные коммуникации. Мы можем даже не задумываться, но каждое наше действие в интернете — поисковый запрос, лайк поста или обработка промпта нейросетью — это обращение к серверной инфраструктуре.

Ответом индустрии на этот тренд становится оптимизация ресурсов: внедрение специализированных ускорителей под конкретные задачи, распределение нагрузки между дата-центрами и edge-узлами, совершенствование софта.

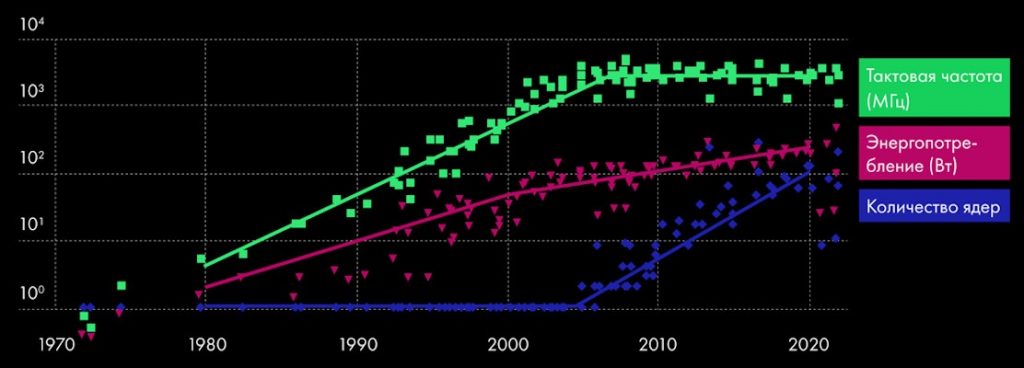

Но как и у всякого пути, у дальнейшего развития серверов есть не только возможности, но и ограничения. Одна такая грань — рабочая частота процессора и тепловыделение.

Логично предположить, что если увеличить частоту процессора, то его производительность линейно вырастет. Но дальше так развивать технологию не получится: максимальную частоту ядер ограничивают как тепловыделение, так и физические пределы самой полупроводниковой технологии. Даже если разместить на одном чипе множество ядер, то запустить их все на максимальной частоте не удастся. Ресурс на увеличение чипа для кремниевой технологии исчерпывается.

Другая грань — увеличение IPC (instructions per cycle), то есть количества инструкций, которые процессор выполняет за один такт. При таком подходе не разгоняют частоту, а «выжимают» больше работы из каждого цикла.

Звучит неплохо, но на практике это требует серьезного усложнения архитектуры, ведь процессор должен уметь предугадывать команды, параллельно обрабатывать несколько потоков данных, держать больше кэша и логики управления. Все это резко увеличивает площадь чипа, энергопотребление и сложность разработки.

И это далеко не все «тупики», в которые упирается современная серверная индустрия на пути совершенствования. Существуют куда более фундаментальные ограничения.

Ограничение 1: охлаждение

Первый фундаментальный тормоз — дальнейшее развитие серверов ограничивает бурный рост их энергопотребления. Попытка увеличить производительность приводит к тому, что все больше ресурсов уходит на охлаждение. Если раньше на инфраструктуру расходовалось около 30% общей электроэнергии, то сейчас уже порядка 40%.

Ограничение 2: полупроводники

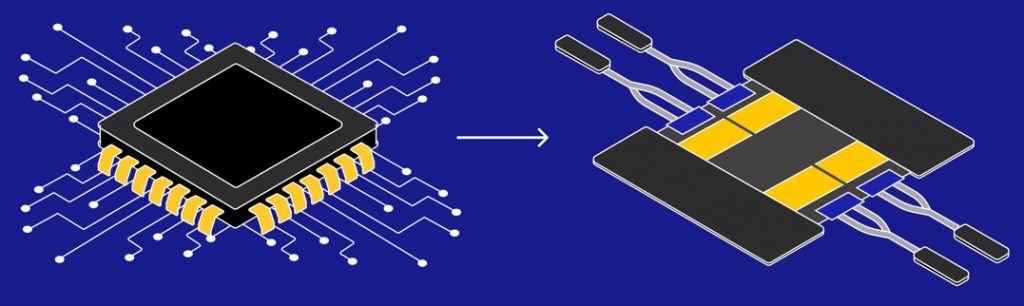

Еще один очевидный предел — размеры микросхемы. Это связано как с физическими ограничениями, то есть размером атома, так и технологическими. Сейчас применяется метод литографии, который подразумевает экспонирование на чип определенного рисунка и последующего его стравливания.

При этом разработчики использовали более короткую длину волны и уже перешли к жесткому ультрафиолету — технологии создания микрочипов с использованием сверхкороткого излучения.

Серверная индустрия в 2030-х: подводные дата-центры, пещеры и космос

Ожидается, что в ближайшие десять лет запрос на серверные мощности вырастет в десятки раз — в том числе из-за развития искусственного интеллекта. А значит, понадобится инфраструктура в десятки раз крупнее существующей. Это серьезный вызов.

Как на него ответить? Можно пойти старыми путями и «выжимать» из технологий чуть больше снова и снова. Но однажды это перестанет работать, и тогда всё же нужно будет менять подходы к энергозатратам и самой архитектуре хранения данных. Какие альтернативы здесь видны на горизонте?

Сокращение энергозатрат

Например, размещение ЦОДов в океане и пещерах.

Современные гиперскейлеры настолько масштабны, что могут позволить себе разработку любого вида серверов — даже подводного. Варианты размещения дата-центров под водой уже прорабатывали, и здесь есть очевидные плюсы: вода обладает высокой теплоемкостью и может эффективно отводить тепло от оборудования.

Однако этот сценарий сопряжен и с понятными сложностями — для обслуживания инфраструктуры требуется либо физическое погружение, либо сложные системы дистанционной диагностики и ремонта. Кроме того, подводные дата-центры предъявляют повышенные требования к герметичности, надежности компонентов и автономности работы. В итоге любая неисправность обходится кратно дороже, чем на суше.

Компромиссный вариант — дата-центры в пещерах, сберегающих прохладу круглый год. Здесь логика та же, что и с океаном. Если снизить потребление самих процессоров мы не в силах, то остается уменьшать накладные расходы на отвод тепла.

Космос: бесплатная энергия в перспективе

Если океан и пещеры позволят частично экономить энергию на охлаждение ЦОДов, то космос рассматривается как вариант полностью закрыть энергетический дефицит. Что может быть лучше? В космосе солнечная энергия доступна практически постоянно и достается условно бесплатно.

Однако даже с учетом регулярных полетов Starship и удешевления вывода на орбиту полезного груза космические ЦОДы пока остаются мысленным экспериментом: стоимость доставки оборудования все еще слишком высока для массового развертывания.

Оптимизация архитектуры

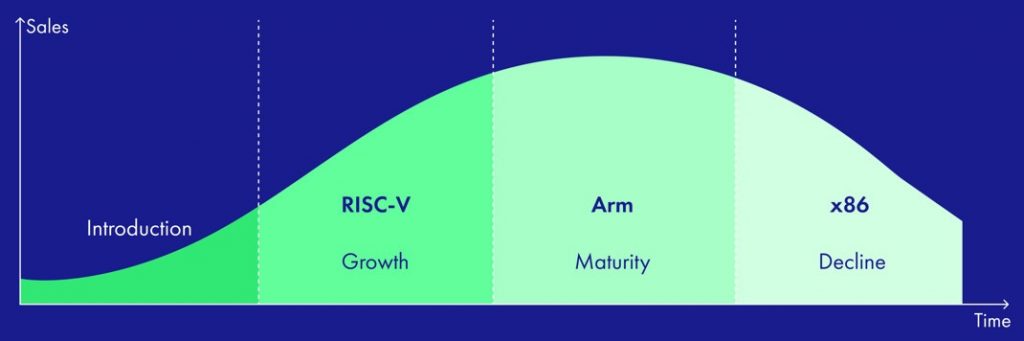

Некоторые эксперты полагают, что x86 находится на своем закате, и архитектура, которую рассматривают в качестве альтернативы ей, называется ARM.

В отличие от x86, ARM строится на более простом и энергоэффективном наборе команд, что делает такие процессоры особенно подходящими для систем с ограниченным энергопотреблением, например, смартфона.

Но если еще лет 15 назад ARM рассматривалась исключительно как процессор для мобильных применений, то сейчас уже есть производительные многоядерные ARM-процессоры, которые используются гиперскейлерами, в том числе в дата-центрах.

Хотя от x86 пока никто окончательно не отказался, ARM переходит к стадии зрелости, и в качестве следующего кандидата уже просматривается RISC-V — открытая архитектура, не отягощенная ограничениями и способная развиваться.

Отдельная история — ускорители для ИИ. Искусственный интеллект изначально строился на классических GPU, затем появились тензорные процессоры, а сейчас возникает целый ансамбль специализированных чипов. Цель одна — снизить количество энергии на единицу полезного действия.

Однако развитие серверной индустрии сдерживает не только вопрос энергозатрат. Не меньшая проблема связана с тем, что передовые техпроцессы налажены лишь в нескольких компаниях по всему миру, и их мощности расписаны на годы вперед. Именно поэтому в отрасли обсуждается строительство так называемых террафабов — производств принципиально нового масштаба.

Порог входа в разработку микросхем тоже весьма сложный. Сегодня инструменты проектирования чипов сосредоточены у двух вендоров — Cadence и Synopsys. Лицензии стоят миллионы долларов, что делает область недоступной для небольших команд и тем более для студентов.

Экономия на логистике данных

Дата-центр способен обработать огромный объем данных, но их бывает неудобно доставлять. Альтернативой может служить обработка информации на месте ее первичного сбора.

Хороший пример такой системы — городское видеонаблюдение. Камера не передает картинку для процессинга в дата-центр, а обрабатывает весь видеопоток там, где находится. Современное аппаратное обеспечение на это вполне способно.

Телеком-операторам проще разместить кеширующий сервер рядом с той точкой, где данные используются, чем гонять видеопоток. Это требует широких каналов, проводить которые дорого и сложно. Однако все три сценария, описанные выше, приносят лишь отсрочку от неизбежного — появление революционных подходов.

Революционный скачок. 2030-е и дальше

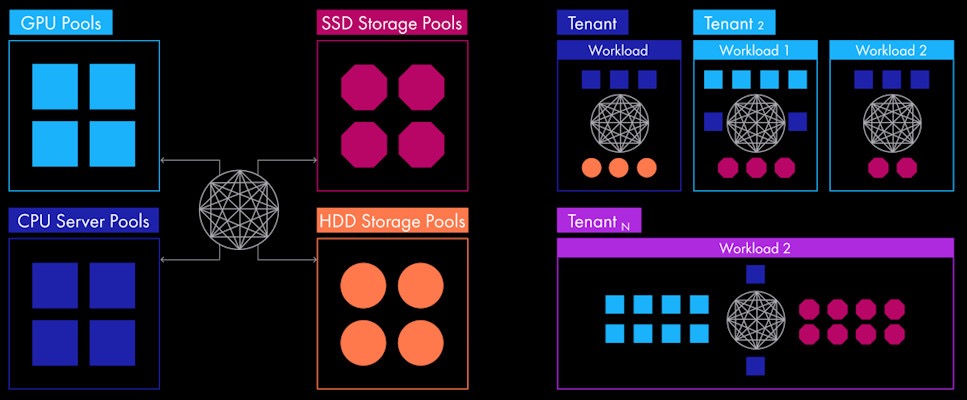

Один из таких возможных скачков — дезагрегация. Это не новая идея, однако пока она не нашла оптимального пути реализации. По сути, это разделение физического сервера на отдельные, независимые модули, то есть вычислительные мощности, память и хранилище, которые объединяются в сеть, а не находятся в одном корпусе.

Это позволяет обновлять компоненты независимо, снижает энергопотребление и повышает эффективность использования ресурсов — утилизацию.

Пока концепция не получила массового внедрения, потому что для дезагрегации нужны новые типы соединений — интерконнекта — и коммутационные фабрики, то есть сети, которые связывают компоненты системы так, будто они находятся внутри одного сервера. Обычные интерфейсы для этого не подходят, так как они либо слишком медленные, либо дают слишком большую задержку.

Ситуация начала меняться с появлением новых стандартов, таких как Compute Express Link. Это высокоскоростной интерконнект, который дает возможность процессору работать с внешней памятью и ускорителями почти так же, как с локальными. Стандарт активно развивается, появляются коммутаторы с большим количеством портов, что позволяет строить те самые дезагрегированные фабрики.

Серверы, фабрики, чипы… А что с памятью?

Это еще один важнейший вопрос при оценке перспектив развития серверной индустрии. Ведь даже если научиться гибко соединять процессоры, ускорители и накопители в единую систему, без памяти эволюции не будет. Именно она во многом определяет, насколько быстро система может работать с данными и масштабироваться. И здесь есть свои ограничения: скорость, стоимость и способ организации.

Что будет через десять лет

Сегодня уже есть предпосылки к тому, что развитие серверов пойдет по пути дезагрегации. Конечно, это будет не дезагрегация уровня дата-центра, но выход на уровень одной стойки или хотя бы части стойки существенно повысит утилизацию ресурсов. Они будут разноситься по узлам и собираться под задачу в реальном времени.

А вот новые типы вычислений — оптические или квантовые — в ближайшие годы, скорее всего, останутся нишевыми. Основной прогресс здесь будет идти через улучшение связей между компонентами, появление новых типов памяти и усложнение систем управления.

От памяти будет зависеть очень многое, но предсказывать этот трек пока сложно. Можно лишь предположить, что если появится массовая Storage Class Memory, то архитектура серверов изменится сильнее, чем от любых новых процессоров. Если же такого прорыва не произойдет, индустрия продолжит двигаться эволюционно через дезагрегацию, специализированные ускорители и более сложные системы оркестрации.

В обоих сценариях меняется главное: усложняется объект разработки. Инженеры больше не проектируют отдельный сервер, а собирают распределенную систему, где важен баланс между скоростью, стоимостью и энергопотреблением. И чем сложнее становится эта система, тем выше требования к тем, кто ее создает. Это ли не повод следить за дальнейшей историей развития серверов с особым интересом?