Бульон из кварк-глюонной плазмы: как подмосковный ЦОД «переваривает» петабайты данных о Большом взрыве

с помощью нейросети

Современная физика элементарных частиц невозможна без цифровой обработки информации. Крупнейшие ускорители мира каждый год генерируют петабайты данных о первых мгновениях Вселенной — а это числа с 15 нулями. «Переварить» их по силам лишь специализированным дата-центрам, объединенным в глобальную вычислительную сеть.

Один из таких центров находится в подмосковной Дубне — в Объединенном институте ядерных исследований (ОИЯИ). Главный инженер Многофункционального информационно-вычислительного комплекса ОИЯИ Алексей Воронцов рассказывает, как устроена эта инфраструктура.

- чем ЦОД в Дубне отличается от обычного дата-центра

- как работает уникальная система охлаждения суперкомпьютера «Говорун»

- в чем разница инженерного и научного подходов к работе

- как Дубна и ЦЕРН дополняют друг друга в изучении физики

Братья, но не близнецы: что объединяет Дубну с крупнейшей физической лабораторией мира

Когда в одиннадцать лет я разбирал свой первый компьютер с процессором 386 и операционкой MS-DOS, то и представить не мог, что когда-нибудь буду работать в одном из ведущих вычислительных центров мира — отвечать здесь за инженерию, которая помогает изучать первые мгновения существования Вселенной. Но инстинкт железячника привел именно сюда — в Лабораторию информационных технологий ОИЯИ.

Теперь среди моих коллег выдающиеся физики и суперкомпьютер «Говорун» — мозговой центр искусственного интеллекта нашего института. К суперкомпьютеру мы еще вернемся, но сначала расскажу про его создателя — Объединенный институт ядерных исследований.

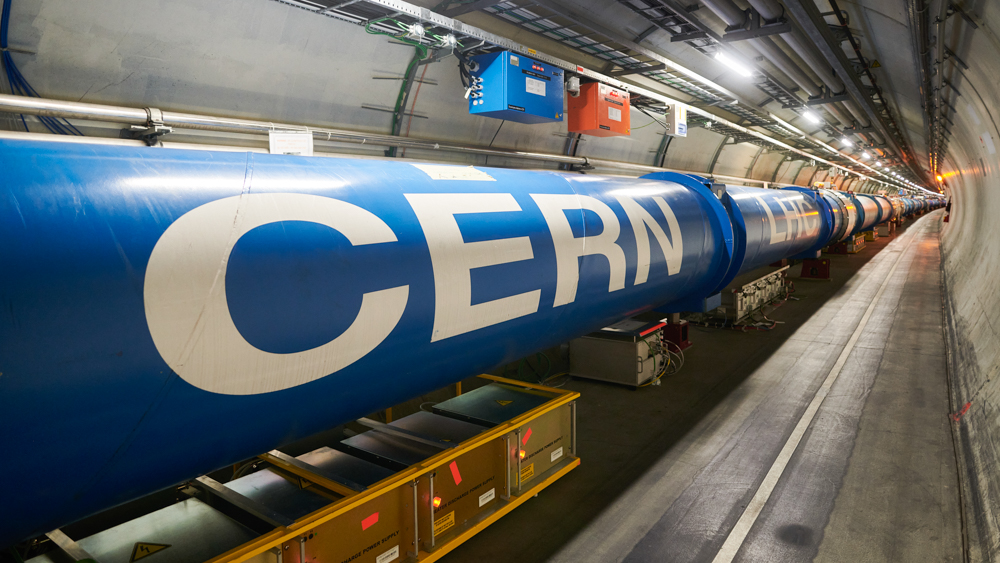

ОИЯИ нередко сравнивают с его европейским собратом — научным центром ЦЕРН. Общего между ними действительно много — оба занимаются изучением фундаментальной физики и проводят эксперименты на ускорителях, в том числе на коллайдерах. Оба ищут мельчайшие частицы реликтовой материи, образовавшейся в первые доли секунды после образования Вселенной. Но есть и значимые различия. Главное — в подмосковной Дубне и в ЦЕРНе изучают разную физику.

Сейчас в состав ОИЯИ входят 15 стран-участниц и еще несколько государств с соглашениями о сотрудничестве.

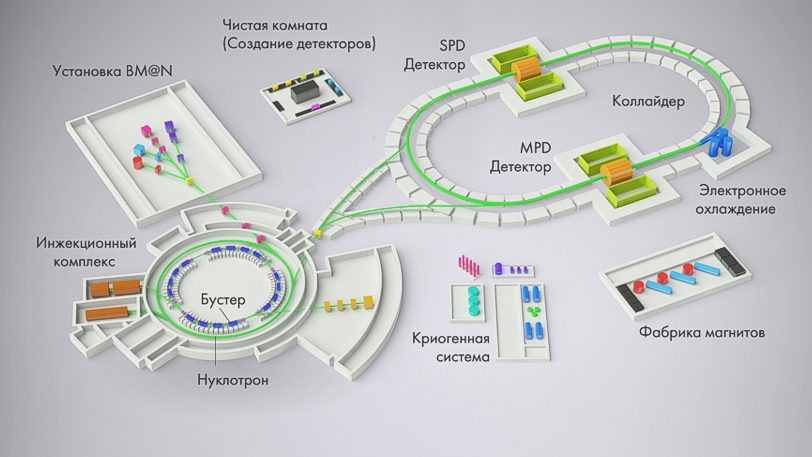

Физики из этих стран с нетерпением ожидают выхода на полную мощность нового коллайдера NICA. Это уникальный комплекс ускорителей, который построили специально для изучения свойств плотной барионной материи — особого состояния вещества, которое существовало в первые микросекунды после Большого взрыва. Как полагают ученые, тогда материи еще не было — только «бульон» из кварк-глюонной плазмы. Задача NICA заключается в том, чтобы воссоздать этот бульон в очень маленьком масштабе.

Однако получить такое изысканное «блюдо» — это лишь полдела. Не менее важно «переварить» его: обработать результаты научных экспериментов, сохранить массивы данных и сделать их доступными для анализа международным сообществом. Эта миссия выглядит титанической, но Дубне — одному из ключевых узлов глобальной сети по обработке данных с Большого адронного коллайдера (БАК) в ЦЕРНе — эта задача вполне по плечу.

Но это только начало: с полным запуском NICA поток информации вырастет в разы, и подмосковный наукоград станет одним из крупнейших «цифровых реакторов» для обработки научных данных в мире.

«Всемирная паутина» ЦОДов: как мир делит вычисления

К концу девяностых, когда БАК еще только проектировался, научное сообщество уже понимало, что справиться с возрастающим потоком экспериментальных данных в одиночку не получится ни у кого. Нужна была новая глобальная архитектура.

Хиггс теоретически описал эту частицу еще в 1964 году, но экспериментальное подтверждение ее существования получили именно на Большом адронном коллайдере — в том числе при участии наших коллег. Среди моих знакомых есть соавторы этого открытия, а данные считались в том числе на нашем оборудовании.

Миссия проекта WLCG, глобальной вычислительной сети для Большого адронного коллайдера, подразумевает хранение 50−70 петабайт данных, которые коллайдер генерирует ежегодно.

Сегодня в сети WLCG 170 центров из 42 стран, а это в общей сумме более 1,4 миллионов процессорных ядер и 2 эксабайта хранилищ. Каждый день через нее проходит более двух миллионов вычислительных задач.

Устроена эта система в три уровня, и логика тут простая:

- Tier-0 — это сам ЦЕРН: центр, который стоит рядом с детекторами и первым принимает данные. Здесь происходит запись, первичная реконструкция событий и распределение данных по всему миру.

- Tier-1— следующее звено: постоянное хранение и тяжелая повторная обработка.

- Tier-2— самый распространенный элемент системы. В Tier-2 занимаются моделированием и физическим анализом.

Дубна в глобальной сети: Tier-1 в Восточной Европе

ЦОД уровня Tier-1 — мировая редкость. На всей планете таковых не наберется и двух десятков. ЦОДы первого уровня, задействованные в экспериментах на Большом адронном коллайдере, расположены в России, Франции, Германии, Италии, Испании, на Тайване, в Великобритании и США. Дубна — Tier-1 для эксперимента CMS в Восточной Европе и СНГ.

Хочу здесь отметить, что несмотря на все международные перипетии, сотрудничество между ОИЯИ и ЦЕРНом не останавливалось. И сегодня мы работаем вместе: данные продолжают поступать, сотрудники ездят в командировки и обмениваются опытом. Что бы не происходило вокруг, мы объединяем усилия в решении фундаментальных научных проблем, и это повседневная реальность, которая подтверждается десятками петабайт входящего трафика каждый год. А еще это напрямую отвечает девизу нашего института — наука сближает народы.

Подключена Дубна к мировой Grid-сети несколькими каналами: четыре линии по 100 гигабит в секунду до Москвы, отдельный канал на 100 гигабит до ЦЕРНа и еще один такой же до Амстердама. От Амстердама до ЦЕРНа тоже есть один прямой канал на 100 гигабит — для научных магистралей LHCOPN и LHCONE.

Вклад Дубны в инфраструктуру системы Grid — это 800 квадратных метров машинного зала в здании нашей Лаборатории информационных технологий. Здесь размещены модули, каждый из которых представляет собой два ряда телекоммуникационных шкафов, объединенных общей крышей. Выглядит это своеобразно, и между собой мы называем такие модули «теплицами».

Ленточные библиотеки: архив с 30-летней гарантией

Важный элемент системы хранения нашего ЦОДа — магнитная библиотека. Он нужен для того, чтобы экспериментальные данные были доступны десятилетиями.

Именно на ленте — это не оговорка. Для долгосрочного хранения мы используем магнитные ленты. Звучит как технология из прошлого века, но ничего надежнее человечество пока не придумало.

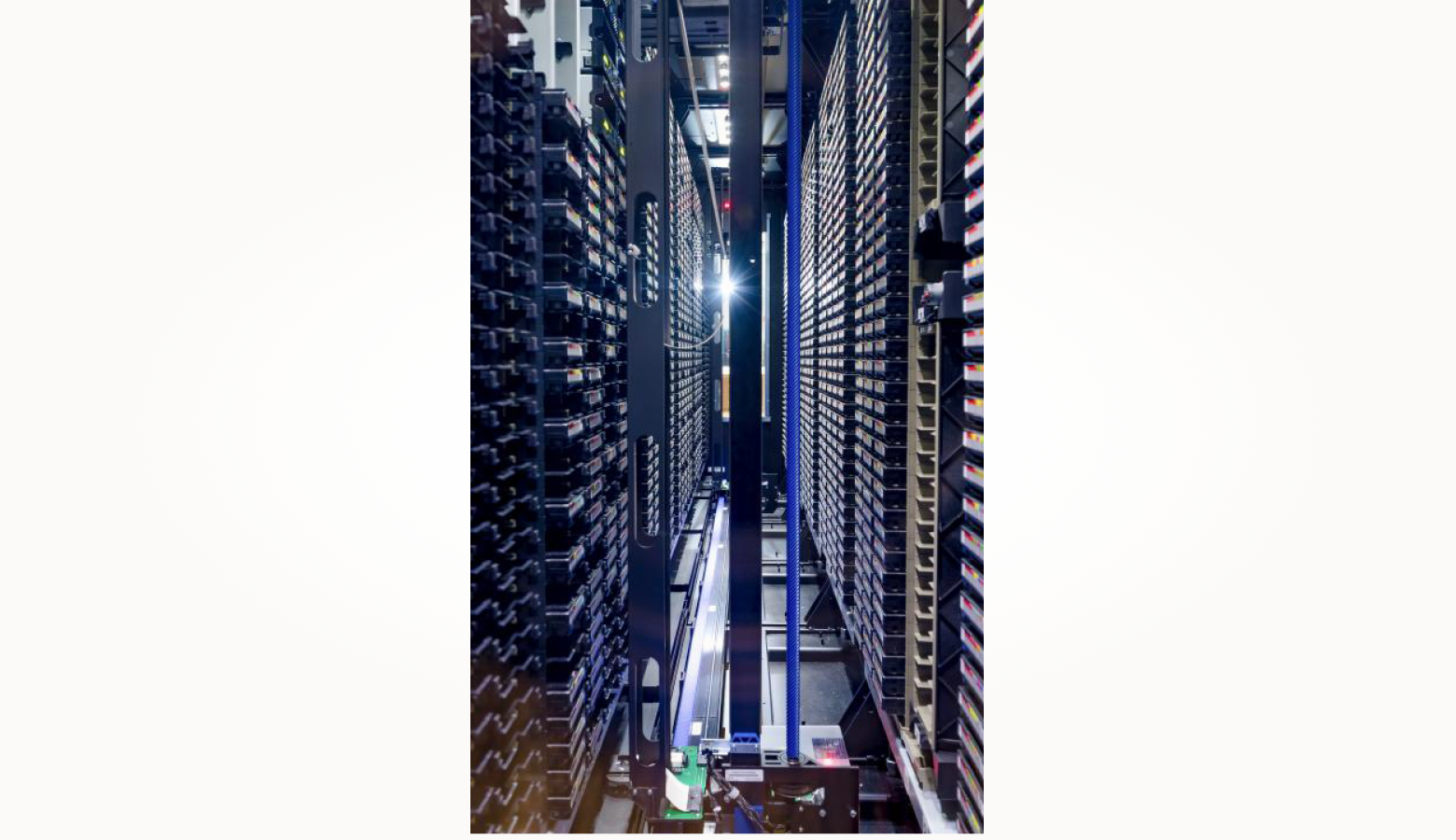

У нас стоят две роботизированные библиотеки IBM — TS3500 емкостью около 12 петабайт и более новая TS4500 на 100 петабайт. Лента живет 30 и больше лет, тогда как жесткий диск выходит из строя через три-пять. Для данных, которые должны пережить целую научную эпоху, выбор очевиден.

А для оперативной работы есть географически распределенные хранилища, откуда физики забирают данные для текущих расчетов.

«Говорун»: супермозг без фреона и чиллеров

Суперкомпьютер «Говорун» — первый в мире гиперконвергентный комплекс для высокопроизводительных вычислений с полностью жидкостным охлаждением. В основе построения гиперконвергентной системы лежит подход объединения ресурсов для вычисления и хранения на каждом узле системы. Это позволяет наиболее эффективно масштабировать общие ресурсы системы с увеличением количества узлов.

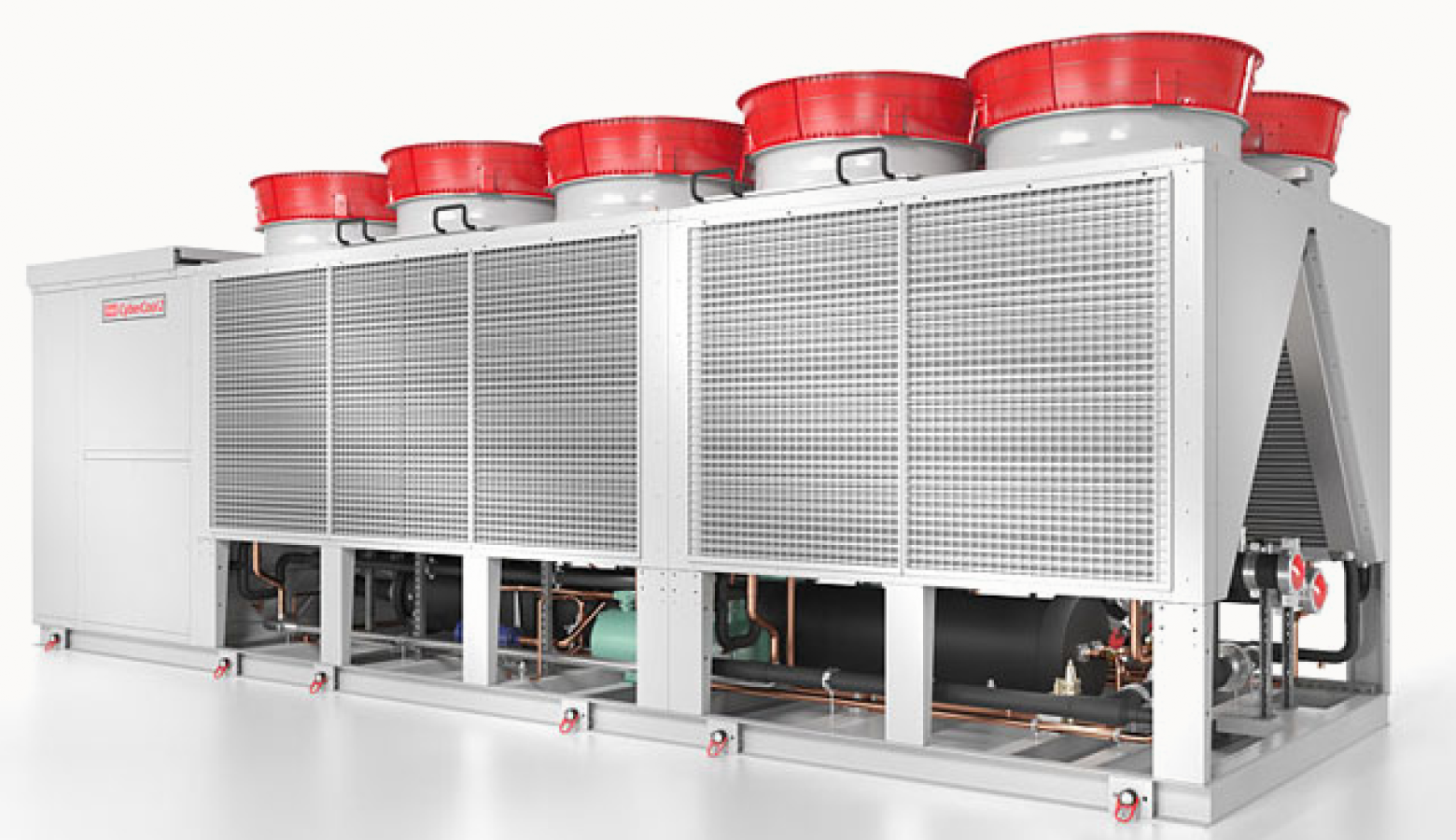

Главная инженерная особенность «Говоруна» кроется в том, как устроено его охлаждение. Процессорная часть суперкомпьютера не перегревается благодаря обычной воде — никаких токсичных фреонов, чиллеров и кондиционеров с компрессорами.

Тепло от серверов отводит сухая градирня — по сути, большой уличный конвектор, который работает по тому же принципу, что и гигантский автомобильный радиатор. Между градирней и суперкомпьютером выстроены два контура, в наружном циркулирует пропиленгликоль — незамерзающий теплоноситель, который спокойно выдерживает подмосковные морозы.

Из градирни он попадает в коллектор, а оттуда — в теплообменник, где охлаждает воду внутреннего контура. Уже эта вода поднимается в четыре серверные стойки «Говоруна», проходит через специальные теплораспределительные пластины на процессорах, нагревается всего на пять градусов и возвращается обратно в теплообменник, чтобы начать цикл заново.

Такая схема сделала лабораторию в Дубне одним из самых энергоэффективных вычислительных центров мира. PUE всей площадки — 1,06. Это значит, что на инфраструктуру охлаждения уходит лишь 6% мощности — по сути, только на работу насосов. Остальная энергия поступает прямо в процессоры и работает на науку.

На другой уровень: энергопотребление систем хранения данных

Четыре стойки «Говоруна» потребляют около 100 кВт — это сам вычислительный кластер, на котором выполняются ресурсоемкие расчеты, и анализ. Для такой инфраструктуры двухконтурной схемы охлаждения с градирней и пропиленгликолем достаточно.

Но «Говорун» — лишь часть вычислительного центра в Дубне. В машинном зале размещены десятки стоек для Tier-1 и Tier-2, а также облачные серверы и ленточные библиотеки на сотни петабайт.

Благодаря всему этому оборудованию совокупная мощность зала достигает двух мегаватт. И вот здесь одними насосами и пропиленгликолем уже не обойтись.

Чтобы оценить масштаб инфраструктуры, обеспечивающей физиков современными вычислительными инструментами, нам потребуется спуститься на минус первый этаж. Я рекомендую это сделать студентам или высокому начальству, когда ко мне приходят на экскурсию и первым делом фотографируются у «Говоруна».

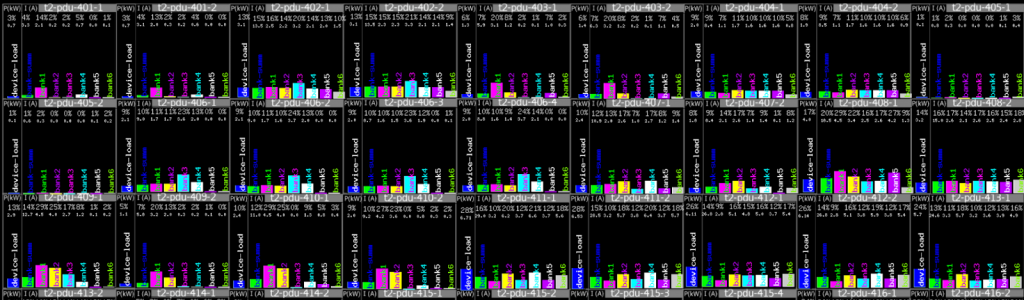

На входе в здание стоят два сухих трансформатора по 2500 кВА каждый. Бесперебойность обеспечивают шесть источников питания APC Galaxy 7000 по 300 кВА и еще два ИБП Riello — в сумме это более 800 аккумуляторных батарей.

А на случай полного отключения электричества на улице дежурят два контейнера с дизель-генераторами: каждый сжигает 335 литров солярки в час при мощности в один мегаватт и способен продержать весь комплекс около восьми часов на полных баках. Но со времени установки генераторов в 2018 году подача электроэнергии прерывалась всего на несколько минут для выполнения плановых работ.

Охлаждение для этого серверного зала из-за его большого энергопотребления устроено принципиально иначе, чем для «Говоруна». Вместо элегантной схемы с градирней и водой здесь работает классическая тяжелая инфраструктура: холодильные машины, насосные станции и межрядные прецизионные кондиционеры. 46 прецизионных машин держат температуру в модулях с точностью до градуса. Сдвинь ее на пару делений — и процессоры начнут троттлить, а GPU выходить из строя.

Конвекция воздуха тщательно продумана: холодный подается под фальшпол, а оттуда поступает в серверные стойки, прокачивается вентиляторами через процессоры и блоки питания, после чего, нагреваясь, поднимается к потолку, где его и забирают кондиционеры.

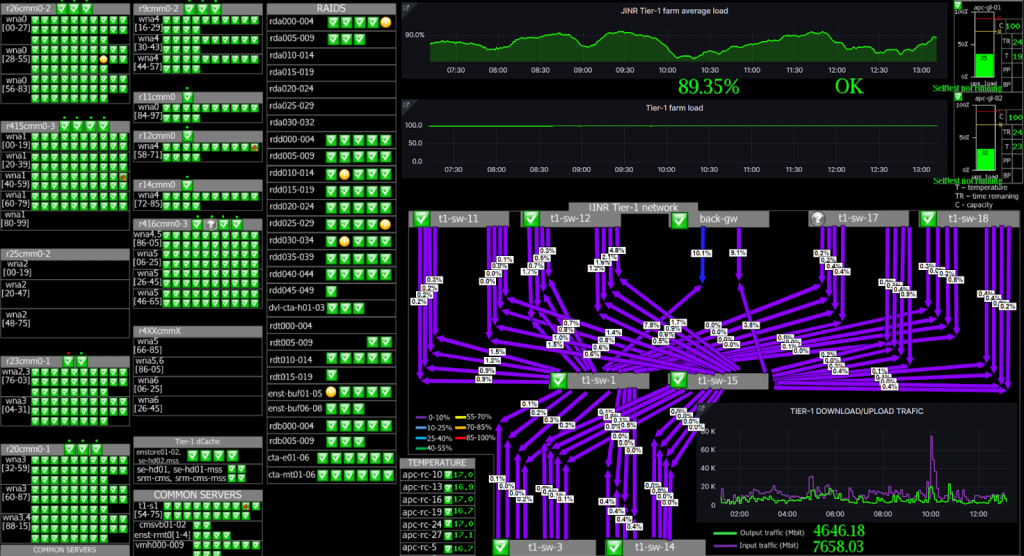

За всем этим хозяйством круглосуточно наблюдают дежурные инженеры из комнаты, которую мы в шутку называем ЦУПом — из-за большого информационного табло, которое напоминает оснащение центра управления полетами.

В нашем «ЦУПе» развернута система мониторинга, которая ежесуточно проводит порядка 16 000 проверок на 1800 узлах, а на информационных панелях в реальном времени отображаются температура в каждой стойке, нагрузка по фазам электропитания, сетевой трафик, состояние серверов и дисков.

При обнаружении любой неисправности дежурные немедленно докладывают профильным инженерным службам и параллельно сами принимают меры по устранению.

Взаимное ускорение: как инженеры превращают амбиции физиков в вычислительные решения

В заключение подчеркну, что физики хотят обрабатывать всё больше данных и делать это всё быстрее. Благодаря этому развиваются технологии, наука идет вперед. Но без нас, инженеров, эти амбиции остались бы просто идеями на бумаге. Наша задача придумать, как эти цели претворить в жизнь.

При этом мы всегда должны играть на опережение: наращивать вычислительные мощности, модернизировать охлаждение и электропитание, продумывать ресурсы на годы вперед, хотя объективная реальность такова, что мы постоянно упираемся в ограничения.

Поэтому всегда приходится балансировать между модернизацией вычислительных мощностей и модернизацией инженерной инфраструктуры. Это бесконечная гонка. Но деваться некуда, и каждый год, пока наращиваем мощности, демонтируем морально устаревшее оборудование и принимаем фуры с новыми серверами, мы мотивируем себя одной простой мыслью: даже самый именитый ученый ничего не смог бы поделать без толкового инженера.